Annotation

- Introducción

- Desbloqueando la Transcripción de Reuniones Impulsada por IA

- El Desafío de la Documentación Moderna de Reuniones

- Presentando Whisper y Llama: El Dúo Poderoso de IA

- Configuración e Instalación

- Configuración de la Transcripción

- Técnicas de Resumen

- Análisis de Costos y Accesibilidad

- Características Avanzadas y Personalización

- Escenarios de Implementación y Optimización

- Desarrollos Futuros y Mejoras

- Pros y Contras

- Conclusión

- Preguntas frecuentes

Transcripción de Reuniones con IA: Guía de Configuración de Whisper y Llama para Notas Automatizadas

Aprende a configurar la transcripción de reuniones con IA usando Whisper y Llama para convertir automáticamente audio en texto y generar resúmenes, ahorrando

Introducción

¿Luchando con horas de grabaciones de reuniones no estructuradas? Esta guía completa demuestra cómo aprovechar Whisper de OpenAI y Llama de Meta para transcribir y resumir automáticamente reuniones en cualquier idioma. Transforme sus grabaciones de audio y video en conocimientos accionables con esta poderosa solución impulsada por IA que revoluciona la documentación de reuniones y los flujos de trabajo de colaboración.

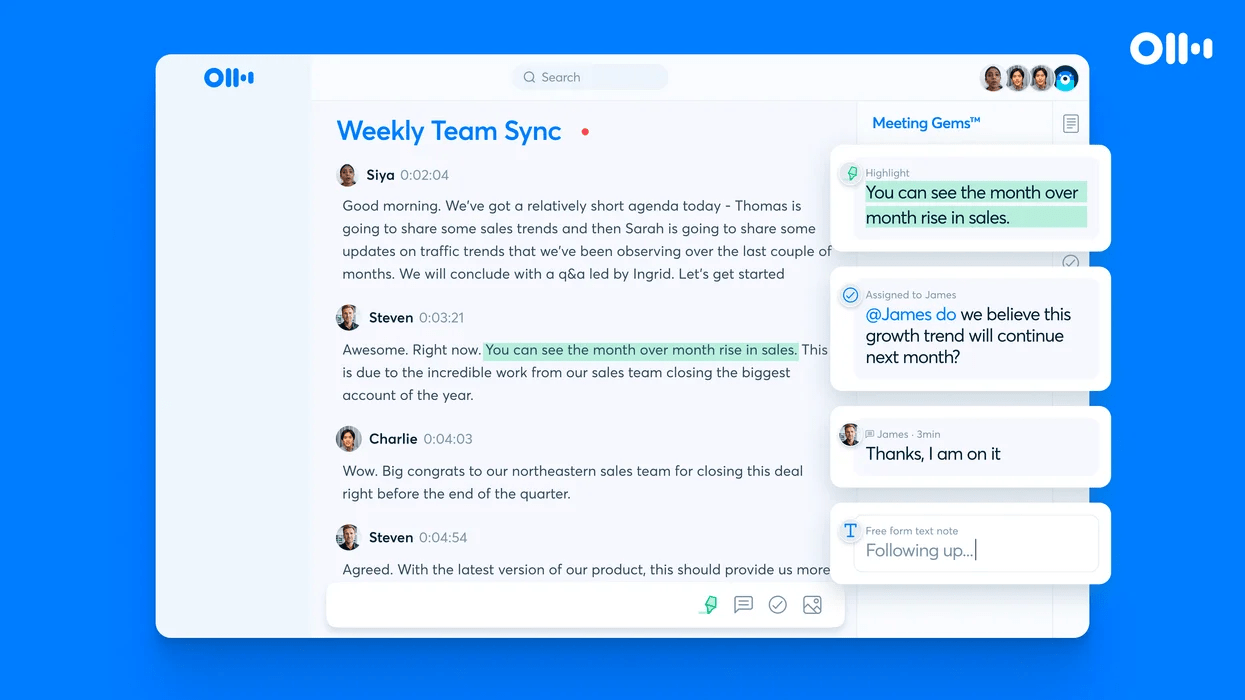

Desbloqueando la Transcripción de Reuniones Impulsada por IA

En el entorno empresarial actual de ritmo acelerado, las reuniones siguen siendo esenciales para la colaboración y la toma de decisiones en las organizaciones. Sin embargo, el desafío de gestionar grabaciones largas y no estructuradas a menudo conduce a ideas perdidas y horas de productividad desperdiciadas. Los métodos tradicionales de transcripción manual no solo consumen mucho tiempo, sino que también son propensos a errores humanos e inconsistencias. Esta guía introduce un enfoque automatizado que utiliza tecnología de reconocimiento de voz de IA de vanguardia que garantiza resultados precisos y consistentes mientras ahorra un tiempo valioso.

El Desafío de la Documentación Moderna de Reuniones

Los equipos modernos enfrentan obstáculos significativos al lidiar con grabaciones de reuniones. La transcripción manual generalmente requiere de 4 a 6 horas por cada hora de audio, creando cuellos de botella sustanciales en la productividad. Además, extraer ideas significativas de las transcripciones en bruto demanda tiempo de análisis adicional. La solución presentada aquí aborda estos puntos problemáticos a través de un procesamiento automatizado que mantiene el contexto mientras identifica puntos clave de discusión, elementos de acción y decisiones.

Presentando Whisper y Llama: El Dúo Poderoso de IA

Este sistema combina dos tecnologías de IA complementarias: Whisper de OpenAI para la conversión de voz a texto y Llama de Meta para la síntesis inteligente. Whisper representa un avance en la tecnología de transcripción automática, admitiendo casi 100 idiomas con una precisión notable. Mientras tanto, Llama sobresale en comprender el contexto y generar resúmenes coherentes que capturan el contenido esencial de la reunión. Juntos, crean una solución integral que transforma el audio en bruto en documentación estructurada y accionable.

Configuración e Instalación

Antes de implementar la canalización de transcripción, una configuración adecuada del entorno es esencial. Comience configurando un entorno virtual de Python para gestionar las dependencias de manera limpia. Los requisitos principales incluyen PyTorch para la ejecución del modelo, Transformers para acceder a modelos preentrenados y utilidades adicionales como tqdm para el seguimiento del progreso. FFmpeg sirve como la base para el manejo de archivos multimedia, permitiendo una conversión sin problemas entre formatos de audio y video para garantizar la compatibilidad con los requisitos de entrada de Whisper. La instalación varía según el sistema operativo, con los usuarios de Windows necesitando agregar FFmpeg a su PATH del sistema, mientras que los usuarios de macOS y Linux generalmente usan gestores de paquetes.

Configuración de la Transcripción

El proceso de transcripción comienza con la preparación del audio, extrayendo pistas de grabaciones de video usando FFmpeg. Whisper procesa el audio a través de su red neuronal, dividiendo el contenido en segmentos manejables de 30 segundos con marcas de tiempo precisas para una fácil referencia. Whisper ofrece múltiples tamaños de modelo que equilibran velocidad y precisión, desde pequeño para un procesamiento rápido hasta grande para una precisión mejorada en discusiones complejas. Admite modos de transcripción y traducción, ideales para entornos de equipo multilingües.

Técnicas de Resumen

Después de la transcripción, Llama procesa el texto para generar resúmenes concisos de la reunión. El modelo Llama 3.2 con 3 mil millones de parámetros logra un equilibrio óptimo entre comprensión y necesidades computacionales, mientras que la variante de 1 mil millones de parámetros se adapta a hardware limitado. La calidad del resumen depende de la ingeniería de prompts; prompts personalizables como "Generar actas ejecutivas de la reunión destacando decisiones y elementos de acción" guían los formatos de salida. Añadir aleatoriedad controlada a través de ajustes de temperatura y límites de tokens alrededor de 1000 palabras produce resúmenes completos pero concisos.

Análisis de Costos y Accesibilidad

La combinación Whisper-Llama ofrece un valor excepcional en comparación con los servicios de transcripción comerciales. Whisper opera completamente gratis, mientras que la naturaleza de código abierto de Llama elimina los costos de licencia, haciéndolo atractivo para startups, instituciones educativas y organizaciones con necesidades frecuentes de documentación de reuniones. La ausencia de cargos por minuto o tarifas de suscripción permite un uso ilimitado dentro de las limitaciones de hardware.

Características Avanzadas y Personalización

El amplio soporte de idiomas del sistema lo hace invaluable para organizaciones internacionales, permitiendo reuniones en idiomas nativos con resúmenes estandarizados en inglés o transcripciones en el idioma original. Más allá de la transcripción básica, la canalización ofrece puntos de personalización para diferentes tipos de reuniones: revisiones técnicas, discusiones con clientes o lluvias de ideas internas. La integración con plataformas de automatización más amplias permitirá flujos de trabajo de documentación de reuniones más sofisticados con una intervención humana mínima.

Escenarios de Implementación y Optimización

Los equipos corporativos pueden transformar las reuniones de estrategia semanales en archivos buscables con decisiones destacadas. Las instituciones educativas documentan conferencias, los profesionales legales crean registros de deposiciones y las organizaciones de salud mantienen notas de pacientes. Para procesar numerosas reuniones, el procesamiento por lotes maximiza la utilización de la GPU, el preprocesamiento de audio mejora la precisión y las bibliotecas de plantillas agilizan la gestión de prompts. Estas estrategias ayudan a escalar la solución en todos los departamentos y casos de uso.

Desarrollos Futuros y Mejoras

El panorama de la IA en rápida evolución promete mejoras en la precisión de la transcripción y la calidad del resumen. Las capacidades emergentes incluyen diarización de hablantes, detección de emociones y extracción automática de elementos de acción. La integración con plataformas de automatización más amplias permitirá flujos de trabajo de documentación de reuniones más sofisticados con una intervención humana mínima.

Pros y Contras

Ventajas

- Automatiza tareas tediosas de transcripción y resumen manual

- Admite casi 100 idiomas para la colaboración de equipos globales

- Solución completamente gratuita sin costos recurrentes de licencia

- Altamente personalizable a través de ingeniería de prompts y parámetros

- Genera transcripciones con marcas de tiempo para fácil referencia y navegación

- Adaptable a varias configuraciones de hardware y capacidades de GPU

- Produce documentación de reuniones estructurada y consistente automáticamente

Desventajas

- Potencial de alucinaciones fácticas comunes en modelos de lenguaje grandes

- Requiere configuración técnica y conocimientos de codificación para la implementación

- La velocidad de procesamiento depende en gran medida de los recursos de GPU disponibles

- La precisión puede variar con la calidad del audio y los acentos de los hablantes

- Capacidades limitadas en tiempo real para la transcripción de reuniones en vivo

Conclusión

La combinación de Whisper de OpenAI y Llama de Meta crea una solución poderosa y rentable para la transcripción y síntesis automatizada de reuniones. Esta guía proporciona la base técnica completa para implementar este enfoque impulsado por IA, desde la configuración del entorno hasta las técnicas de optimización. Al adoptar este sistema, las organizaciones pueden reducir significativamente los esfuerzos de documentación manual mientras mejoran la accesibilidad y la capacidad de acción de las ideas de las reuniones en todos sus equipos.

Preguntas frecuentes

¿Qué modelos de IA se utilizan en este sistema de transcripción?

Este sistema utiliza Whisper de OpenAI para la transcripción de voz a texto y Llama de Meta para la resumen inteligente de reuniones. Whisper maneja la conversión de audio a texto, mientras que Llama procesa las transcripciones en actas de reunión concisas.

¿Se requiere FFmpeg para esta configuración?

Sí, FFmpeg es esencial para el procesamiento de archivos multimedia. Convierte formatos de video a audio y garantiza la compatibilidad con los requisitos de entrada de Whisper. Las guías de instalación están disponibles para todos los sistemas operativos principales.

¿Cómo puedo mejorar la calidad del resumen?

La calidad del resumen mejora mediante una cuidadosa ingeniería de prompts y ajuste de parámetros. Personaliza los prompts para tipos específicos de reuniones, ajusta la temperatura para variación y establece límites de tokens apropiados. Experimenta con diferentes frases para optimizar los resultados.

¿Hay opciones para hardware de gama baja?

Sí, tanto Whisper como Llama ofrecen variantes de modelos más pequeños. Usa el modelo pequeño de Whisper y la versión de 1 billón de parámetros de Llama para un procesamiento más rápido en hardware limitado, aunque con algunas compensaciones de precisión.

¿Qué idiomas admite Whisper?

Whisper admite casi 100 idiomas, lo que lo hace adecuado para equipos multilingües y aplicaciones globales, con capacidades precisas de transcripción y traducción para diversos entornos de reuniones.

Artículos relevantes sobre IA y tendencias tecnológicas

Mantente al día con las últimas ideas, herramientas e innovaciones que dan forma al futuro de la IA y la tecnología.

Grok AI: Generación Ilimitada de Videos Gratuita a partir de Texto e Imágenes | Guía 2024

Grok AI ofrece generación ilimitada de videos gratuita a partir de texto e imágenes, haciendo accesible la creación de videos profesionales para todos sin necesidad de habilidades de edición.

Configuración de Grok 4 Fast en Janitor AI: Guía Completa de Juego de Roles Sin Filtros

Guía paso a paso para configurar Grok 4 Fast en Janitor AI para juego de roles sin restricciones, incluyendo configuración de API, ajustes de privacidad y consejos de optimización

Las 3 mejores extensiones gratuitas de IA para programar en VS Code 2025 - Aumenta la productividad

Descubre las mejores extensiones gratuitas de agentes de IA para programar en Visual Studio Code en 2025, incluyendo Gemini Code Assist, Tabnine y Cline, para mejorar tu