Annotation

- Введение

- Понимание YOLO и современного обнаружения объектов

- Настройка окружения: Google Colab и локальная разработка

- Создание высококачественных пользовательских наборов данных

- Эффективная аннотация с Label Studio

- Обучение модели в Google Colab

- Локальное развертывание и практическая реализация

- Плюсы и минусы

- Заключение

- Часто задаваемые вопросы

Обнаружение объектов YOLOv11: Полное руководство по обучению 2024

Узнайте, как обучать и развертывать YOLOv11 для обнаружения объектов с помощью Google Colab и Label Studio. Это руководство охватывает создание наборов данных, аннотацию, модель

Введение

YOLOv11 представляет собой передовой край технологий обнаружения объектов в реальном времени, основываясь на революционной архитектуре You Only Look Once. Это всеобъемлющее руководство проведет вас через обучение пользовательских моделей YOLO с использованием доступных инструментов, таких как Google Colab, создание специализированных наборов данных и развертывание ваших обученных моделей для практических применений. Независимо от того, разрабатываете ли вы системы компьютерного зрения для автономных транспортных средств, розничной аналитики или творческих проектов, этот учебник предоставляет основу для построения надежных решений обнаружения объектов.

Понимание YOLO и современного обнаружения объектов

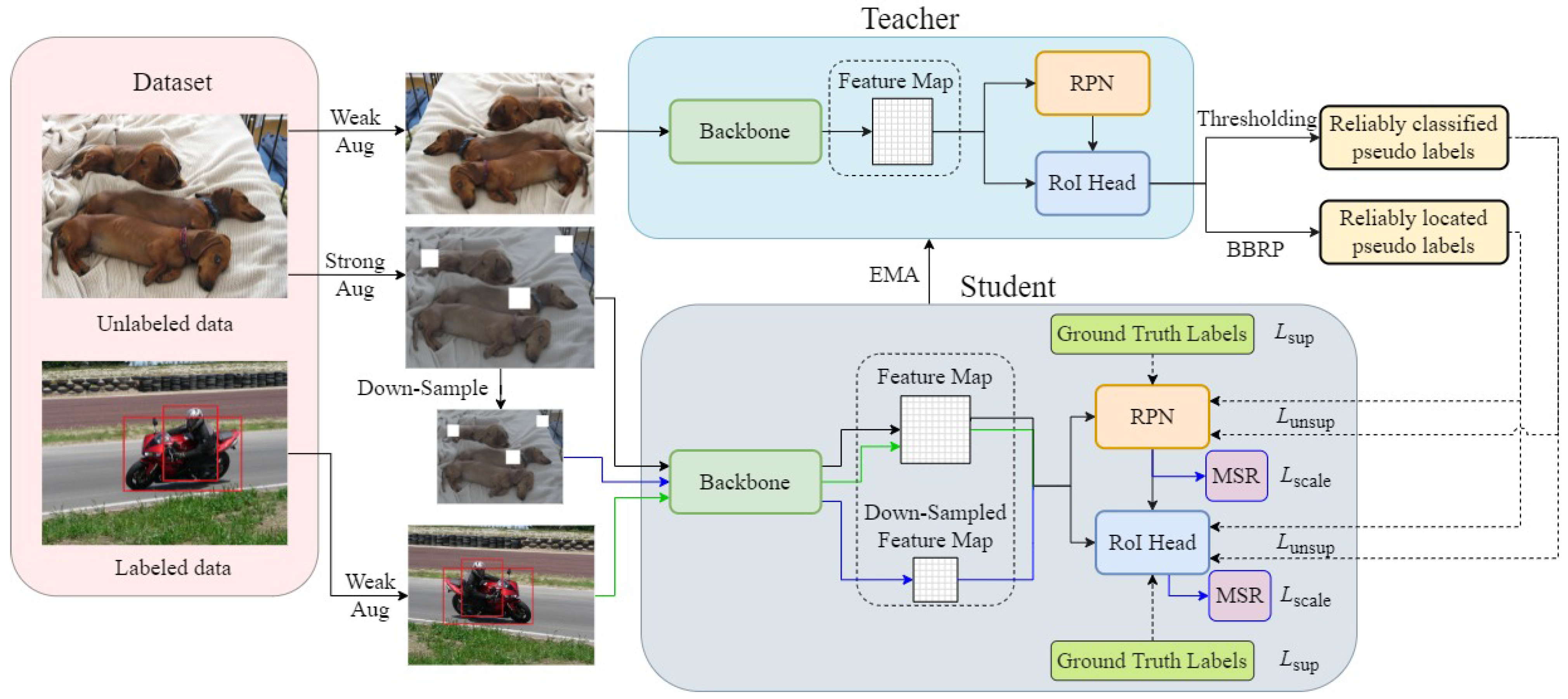

YOLO (You Only Look Once) преобразовал компьютерное зрение, объединив обнаружение объектов в одноэтапный процесс, обеспечивая значительное улучшение скорости по сравнению с традиционными двухэтапными框架ами. YOLOv11 продолжает эту инновацию с архитектурными усовершенствованиями, которые повышают как точность, так и эффективность. Модель обрабатывает целые изображения за один прямой проход через нейронную сеть, одновременно предсказывая ограничивающие рамки и вероятности классов. Этот подход делает YOLOv11 особенно ценным для приложений реального времени, где важна задержка, таких как видеонаблюдение, автономная навигация и интерактивные системы.

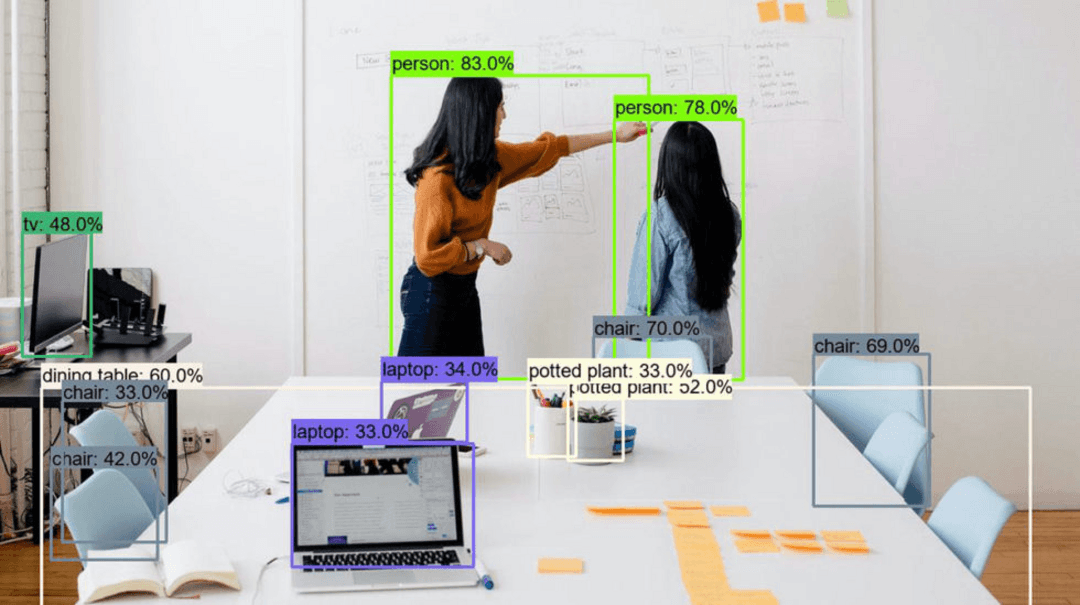

Обнаружение объектов представляет собой значительный прогресс по сравнению с базовой классификацией изображений. В то время как классификация лишь идентифицирует, что находится на изображении, обнаружение точно определяет местоположение объектов с помощью ограничивающих рамок и присваивает соответствующие метки. Это детальное понимание позволяет применять технологию в многочисленных платформах автоматизации ИИ, от промышленного контроля качества до анализа медицинских изображений. Универсальность технологии делает ее доступной для разработчиков, работающих с различными API и SDK ИИ для интеграции в более крупные системы.

Настройка окружения: Google Colab и локальная разработка

Google Colab предоставляет идеальную отправную точку для обучения моделей YOLO, предлагая бесплатный доступ к ресурсам GPU, которые значительно ускоряют вычислительно интенсивный процесс. Эта облачная платформа устраняет необходимость в дорогостоящих инвестициях в оборудование, делая глубокое обучение доступным для отдельных разработчиков и небольших команд. Чтобы начать, убедитесь, что у вас есть активная учетная запись Google, и перейдите на colab.research.google.com. Интерфейс блокнота Jupyter платформы упрощает выполнение кода и экспериментирование.

Для локального развертывания и тестирования Anaconda предлагает надежное решение для управления средами Python и зависимостями. Загрузите дистрибутив с anaconda.com и следуйте мастеру установки. Эта настройка предоставляет изолированные среды, где вы можете устанавливать определенные версии пакетов без конфликтов. Создание выделенных сред для разных проектов обеспечивает воспроизводимость и упрощает управление зависимостями в различных сценариях хостинга моделей ИИ и целях развертывания.

Создание высококачественных пользовательских наборов данных

Основой любой успешной модели обнаружения объектов являются ее обучающие данные. Хорошо структурированный, разнообразный набор данных напрямую влияет на точность модели и возможности обобщения. Для проектов-прототипов стремитесь к 100-200 тщательно отобранным изображениям, которые представляют разнообразие условий, с которыми ваша модель столкнется в производстве. Это включает различные сценарии освещения, фоны, ориентации объектов и потенциальные перекрытия.

Стратегии сбора данных варьируются в зависимости от требований проекта. Для пользовательских приложений, таких как наш пример с обнаружением конфет, захватывайте изображения с помощью смартфонов или веб-камер в различных средах. Дополните свою коллекцию общедоступными наборами данных с платформ, таких как Roboflow Universe или Kaggle, но всегда проверяйте точность меток и релевантность для вашего конкретного случая использования. Организуйте свои изображения в логические структуры папок, например, основную директорию "yolo" с подпапками для разных категорий объектов или источников данных.

Эффективная аннотация с Label Studio

Label Studio упрощает важный процесс аннотации с интуитивно понятным веб-интерфейсом и мощными функциями автоматизации. Этот инструмент с открытым исходным кодом поддерживает различные типы аннотаций, причем ограничивающие рамки необходимы для задач обнаружения объектов. Процесс установки начинается с создания выделенной среды Conda для поддержания чистых зависимостей: conda create --name yolo-env python=3.12, за которым следует pip install label-studio.

Рабочий процесс аннотации включает создание нового проекта, импорт изображений партиями (до 100 за раз, чтобы избежать ограничений сервера) и настройку интерфейса разметки для обнаружения объектов. Замените стандартные метки на ваши конкретные имена классов, затем систематически аннотируйте каждое изображение, рисуя ограничивающие рамки вокруг целевых объектов. Используйте сочетания клавиш для эффективности – нажатие цифровых клавиш, соответствующих индексам классов, значительно ускоряет процесс. После завершения аннотации экспортируйте ваши данные в формате YOLO, который упаковывает изображения и соответствующие файлы меток в загружаемый архив.

Обучение модели в Google Colab

С подготовленными аннотированными данными перейдите к Google Colab для обучения модели. Включите ускорение GPU через Runtime → Change runtime type → GPU, чтобы использовать тензорные процессоры для более быстрых вычислений. Процесс обучения включает несколько настраиваемых параметров: архитектура модели (YOLOv11s для скорости против YOLOv11 для точности), разрешение ввода (обычно 640x640 пикселей) и продолжительность обучения (эпохи).

Отслеживайте прогресс обучения через метрики, такие как потери, точность, полнота и средняя точность (mAP). Эти показатели помогают определить, когда модели сходятся или требуют корректировки. При неоптимальной производительности рассмотрите стратегии, такие как аугментация данных, планирование скорости обучения или архитектурные модификации. Процесс обучения генерирует веса модели (best.pt) и комплексные визуализации результатов в выходной директории, предоставляя insights для итеративного улучшения и интеграции с различными агентами и ассистентами ИИ.

Локальное развертывание и практическая реализация

Развертывание обученных моделей локально требует библиотеки Ultralytics (pip install ultralytics) и ваших экспортированных весов модели. Создайте Python-скрипты, которые загружают модель, обрабатывают входные изображения или видеопотоки и отображают результаты обнаружения. Скрипт развертывания должен обрабатывать различные источники ввода – статические изображения, видеофайлы или потоки с камер в реальном времени – при этом предоставляя настраиваемые параметры для порогов уверенности и форматирования вывода.

Для приложения подсчета калорий конфет расширьте базовую функциональность обнаружения, сопоставляя обнаруженные типы конфет с информацией о питательности. Это демонстрирует, как обнаружение объектов служит основой для более сложных приложений, которые сочетают компьютерное зрение с бизнес-логикой. Такие реализации показывают практическую ценность интеграции моделей YOLO с инструментами захвата экрана и утилитами преобразования изображений для комплексных решений рабочих процессов.

Плюсы и минусы

Преимущества

- Возможности обработки в реальном времени для видео и живых потоков

- Одноэтапная архитектура обеспечивает исключительную скорость

- Реализация с открытым исходным кодом с активной поддержкой сообщества

- Гибкая настройка для конкретных типов объектов

- Совместимость с различными платформами развертывания

- Непрерывные улучшения через обновления версий

- Обширная документация и учебные ресурсы

Недостатки

- Требует значительных размеченных данных для обучения

- Вычислительно интенсивный во время фазы обучения

- Проблемы с очень мелкими или перекрывающимися объектами

- Компромиссы точности с более быстрыми вариантами моделей

- Необходима адаптация домена для специализированных приложений

Заключение

YOLOv11 демократизирует передовое обнаружение объектов с передовой производительностью и доступными инструментами. Это руководство позволяет разработчикам строить пользовательские системы зрения без обширных знаний в ML. Скорость и точность YOLO незаменимы для реальных приложений. Освойте эти техники, чтобы соединить теорию и практику, используя каталоги инструментов ИИ для инноваций.

Часто задаваемые вопросы

Могу ли я использовать существующие наборы данных для обучения YOLO?

Да, платформы, такие как Roboflow Universe, Kaggle и Google Open Images, предлагают предварительно размеченные наборы данных. Всегда проверяйте качество данных и их соответствие вашей конкретной задаче перед обучением.

Как я могу улучшить производительность модели YOLO?

Улучшите производительность, проверяя точность меток, увеличивая количество эпох обучения, используя более крупные архитектуры моделей, расширяя разнообразие наборов данных и применяя методы аугментации данных.

Каковы преимущества Google Colab для обучения YOLO?

Google Colab предоставляет бесплатный доступ к GPU, устраняет требования к локальному оборудованию, предлагает функции совместной работы и включает предустановленные библиотеки машинного обучения для быстрой разработки.

Каковы ключевые улучшения в YOLOv11?

YOLOv11 представляет улучшенную архитектуру для лучшей точности и эффективности, усовершенствованные методы обучения и оптимизированную производительность для обнаружения в реальном времени по сравнению с предыдущими версиями.

Сколько времени занимает обучение модели YOLOv11?

Время обучения варьируется в зависимости от размера набора данных, архитектуры модели и оборудования. Используя Google Colab с GPU, это может занять от нескольких часов до дня для стандартных наборов данных.

Релевантные статьи об ИИ и технологических трендах

Будьте в курсе последних инсайтов, инструментов и инноваций, формирующих будущее ИИ и технологий.

Grok AI: Бесплатное неограниченное создание видео из текста и изображений | Руководство 2024

Grok AI предлагает бесплатное неограниченное создание видео из текста и изображений, делая профессиональное создание видео доступным для всех без навыков редактирования.

Топ-3 бесплатных расширений для ИИ-программирования в VS Code 2025 - Повышение производительности

Откройте для себя лучшие бесплатные расширения для ИИ-программирования в Visual Studio Code в 2025 году, включая Gemini Code Assist, Tabnine и Cline, чтобы улучшить вашу

Настройка Grok 4 Fast в Janitor AI: Полное руководство по ролевой игре без фильтров

Пошаговое руководство по настройке Grok 4 Fast в Janitor AI для неограниченной ролевой игры, включая настройку API, параметры конфиденциальности и советы по оптимизации